Пользователи Apple уже могут отправлять аудиозаписи в iMessage или заставлять Siri зачитывать текстовые сообщения, но в новом патенте Apple предлагается способ заставить устройство читать текстовое сообщение голосом отправителя вместо Siri, используя голосовой файл.

«Голосовая модель предоставляется второму электронному устройству», – говорится в патенте. «В некоторых примерах сообщение принимается от соответствующего пользователя второго электронного устройства».

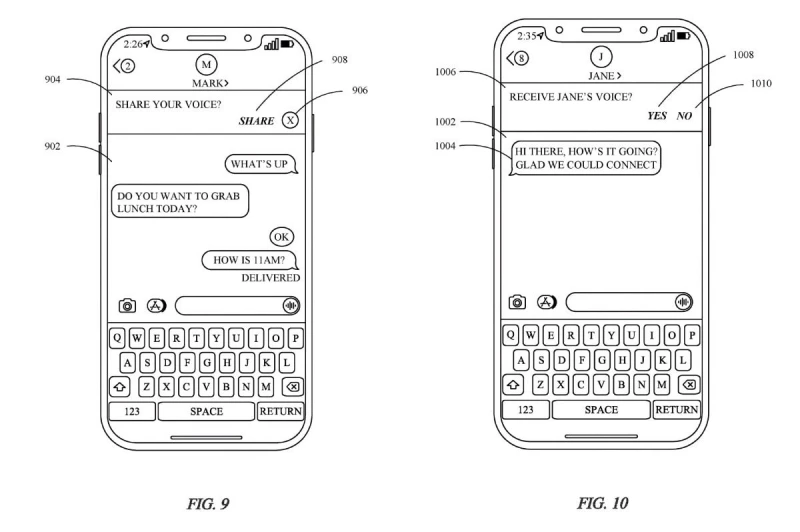

То есть, когда кто-то отправляет сообщение iMessage, он может выбрать вложение голосового файла, который будет храниться на устройстве. Если это произойдет, получателю будет предложено решить, хочет ли он получить и сообщение, и голосовую запись.

«В ответ на получение сообщения принимается голосовая модель соответствующего пользователя», – говорится в патенте. «На основе голосовой модели предоставляется аудиовыход, соответствующий полученному сообщению».

Согласно патенту, iPhone, о котором идет речь, создаст профиль голоса отправителя, подобный Siri, а затем смоделирует его при чтении этого сообщения и всех последующих сообщений, полученных от этого отправителя. Модель имитации голоса также может быть отправлена самостоятельно, чтобы контакты человека могли загрузить ее перед сообщениями.

Это обеспечит большую персонализацию, когда друзья и члены семьи пишут друг другу сообщения, вместо того чтобы слышать голос Siri, когда она читает сообщения. Пары также могли бы слышать сообщения в более индивидуальной форме, например, услышать «Я люблю тебя» голосом своего партнера.

Авторами патента являются Ционг Хай, Цзянчуань Ли и Дэвид А. Винарски. Винарски является директором Apple по технологии преобразования текста в речь, Ли – старший инженер по машинному обучению Siri в Apple, а Ху ранее работал над Siri в компании.

Как обычно бывает с патентами, это не обязательно станет реальностью, но это возможно, учитывая недавнюю работу Apple с искусственным интеллектом и голосами. Например, в iOS 11 Apple перевела голос Siri с записи голоса актеров на модель преобразования текста в речь с помощью машинного обучения.

В 2020 году Apple приобрела компанию Voysis, которая работала над улучшением обработки естественного языка в виртуальных помощниках. Они использовали технологию WaveNet, которая была представлена программой DeepMind компании Google в 2016 году.

WaveNets – это «глубокие генеративные модели необработанных аудиосигналов», которые могут быть использованы для генерации речи, имитирующей любой человеческий голос.

Apple также начала использовать искусственный интеллект для дикторского озвучивания определенных жанров аудиокниг вместо использования людей. Таким образом, патент вполне допускает возможность того, что устройство Apple со временем научится читать сообщения голосом человека.

Комментарии (0)